Introduction : L’IA, un nouveau challenger pour le pentesting ?

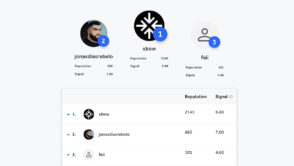

L’univers du pentesting, où se côtoient hackers éthiques et experts en sécurité, est en pleine mutation. Alors que l’intelligence artificielle gagne en popularité dans de nombreux secteurs, une question se pose : l’IA pourrait-elle déjà être un meilleur pentester que l’humain ? La prouesse technique du système XBOW, qui a récemment pris la tête du classement HackerOne aux États-Unis, en est un exemple frappant. Mais au-delà de la performance, se cachent des enjeux cruciaux liés à l’éthique, au futur de la cybersécurité et même à notre rapport au travail. Préparez-vous pour un voyage aussi instructif qu’amusant dans l’univers du pentesting 2.0 !

L’univers du pentesting, où se côtoient hackers éthiques et experts en sécurité, est en pleine mutation. Alors que l’intelligence artificielle gagne en popularité dans de nombreux secteurs, une question se pose : l’IA pourrait-elle déjà être un meilleur pentester que l’humain ? La prouesse technique du système XBOW, qui a récemment pris la tête du classement HackerOne aux États-Unis, en est un exemple frappant. Mais au-delà de la performance, se cachent des enjeux cruciaux liés à l’éthique, au futur de la cybersécurité et même à notre rapport au travail. Préparez-vous pour un voyage aussi instructif qu’amusant dans l’univers du pentesting 2.0 !

Les prouesses techniques de l’IA en pentesting

L’intelligence artificielle ne cesse de surprendre. D’une part, des plateformes comme XBOW démontrent que l’IA peut analyser des vulnérabilités et exécuter des tests de pénétration plus rapidement qu’un pentester humain. D’autre part, plusieurs études (voir par exemple Webasha et TCM-Sec) montrent que l’IA s’améliore continuellement dans la détection d’anomalies grâce à l’apprentissage automatique.

Les avantages sont clairs : rapidité, constance et capacité à traiter de grandes quantités de données en un temps record. Comme dans un film de science-fiction où le robot surpasse son créateur, l’IA semble, sur le papier, lourde de promesses pour dominer le monde du pentesting.

L’humour dans le cyberespace : l’autre visage de la technologie

Mais ne vous méprenez pas, même dans le domaine sérieux de la cybersécurité, l’humour a toute sa place. Imaginez un instant un algorithme qui, après avoir découvert une faille critique, vous adresse : « Même mes circuits ont ri en découvrant cette brèche ! » Cette approche décalée et humaine rappelle le style des articles du Journal Digital Equinoxal, qui mêle information pointue et bonne humeur pour aborder les sujets techno complexes.

Après tout, dans un monde où les hackers se mesurent à des IA ultra-rapides, une petite blague peut être la meilleure manière de dédramatiser la rivalité entre l’humain et la machine. Cela permet également à ceux qui ne sont pas experts de comprendre les enjeux sans se sentir submergés par des termes trop techniques.

Les limites et les défis de l’IA dans le pentesting

Toute médaille a son revers. Si l’IA excelle dans l’analyse de données, elle présente encore des limites lorsqu’il s’agit de percevoir le contexte subtil des environnements de cybersécurité. Par exemple, dans des scénarios complexes où l’intuition et l’expérience humaine sont primordiales, un pentester chevronné saura détecter des vulnérabilités que l’algorithme pourrait ignorer.

Certains experts se posent donc une question délicate : même si l’IA peut identifier des failles à la vitesse de la lumière, est-elle capable de comprendre l’ensemble des implications stratégiques d’un test de pénétration ? Pour approfondir ces interrogations, je vous invite à consulter des analyses détaillées sur l’Impact de l’IA sur le quotidien ou à parcourir nos stratégies digitales.

Les sources comme Webasha et PurpleSec mentionnent par ailleurs que l’IA peut être sujette à des biais et à des erreurs de jugement, en particulier lorsqu’elle est confrontée à des environnements dynamiques et non standardisés. En d’autres termes, la machine a encore beaucoup de leçons à apprendre avant de pouvoir remplacer complètement l’expertise humaine.

Collaboration entre l’IA et l’humain : vers un modèle hybride

La question ne devrait donc pas être de savoir si l’IA est déjà meilleure que l’humain, mais plutôt comment ces deux entités peuvent collaborer pour offrir la meilleure couverture en matière de sécurité. Un modèle hybride, alliant l’efficacité de l’IA et la créativité du pentester humain, pourrait bien représenter l’avenir. L’IA se charge des tâches répétitives et de l’analyse de masse, tandis que l’humain intervient sur les aspects stratégiques et la contextualisation des résultats.

Imaginez un duo gagnant – comme Batman et Robin, ou mieux encore, comme un robot qui vous sert le café avec un clin d’œil ironique après avoir débusqué une faille, pendant qu’un expert humain rédige le rapport final avec toute la finesse qu’exige l’analyse de risques. Cette synergie est d’ailleurs évoquée dans plusieurs publications du domaine et fait l’objet de débats passionnés dans des conférences sur la cybersécurité.

Les enjeux éthiques et la transparence

Au-delà des performances, l’utilisation de l’IA en pentesting soulève des questions éthiques importantes. Qui est responsable en cas de défaillance de l’algorithme ? Comment s’assurer que l’IA respecte les normes de confidentialité et de protection des données ? Ces interrogations sont particulièrement pertinentes dans un domaine où la moindre erreur peut avoir des conséquences lourdes en termes de sécurité.

L’intégration de systèmes autonomes dans des processus critiques doit se faire dans un cadre clair et transparent, avec des audits réguliers et une supervision humaine constante. Dans cet esprit, plusieurs articles sur le Journal Digital Equinoxal abordent ces enjeux en profondeur, offrant des pistes de réflexion pour garantir une cybersécurité éthique et efficace.

Pentesting, IA et l’avenir de la cybersécurité

L’évolution du pentesting, en intégrant de plus en plus l’intelligence artificielle, ouvre la porte à une révolution dans le domaine de la cybersécurité. Cela pourrait être l’aube d’une ère où les menaces sont anticipées et neutralisées avant même qu’elles ne deviennent critiques. Cependant, cette transition s’accompagne de défis majeurs, notamment en termes d’investissement dans la formation des professionnels et la mise en place de régulations adaptées.

Alors que certains voient déjà dans l’IA le futur du pentesting, d’autres estiment que l’humain restera indispensable pour interpréter et contextualiser les données. Ce débat, vif et passionné, est le reflet d’une transformation plus large qui touche l’ensemble du secteur digital. Pour une analyse plus détaillée des tendances de la cybersécurité, rendez-vous sur notre section Innovation Technologique.

Conclusion : L’IA, une alliée de choix mais non un remplaçant total

En conclusion, l’IA offre des performances impressionnantes en matière de pentesting, rivalisant souvent avec l’expertise humaine sur des tâches spécifiques. Cependant, elle ne peut pas encore se substituer entièrement à l’intelligence, la créativité et l’expérience des experts humains. La voie à suivre semble être un modèle hybride qui combine le meilleur des deux mondes.

Face à un cyberespace en constante évolution, l’avenir du pentesting réside dans la coopération entre l’IA et l’humain. Cette synergie permettra non seulement d’améliorer la détection des vulnérabilités, mais aussi de renforcer la sécurité globale des systèmes informatiques. En mettant en place des systèmes transparents et éthiques, la cybersécurité pourra tirer profit des avancées technologiques sans sacrifier la maîtrise humaine.

Pour ceux qui souhaitent rester informés de ces évolutions et découvrir d’autres analyses alliant innovation et humour, n’hésitez pas à explorer le Journal Digital Equinoxal. Vous y trouverez des articles passionnants et des conseils pratiques pour naviguer dans l’univers complexe de la cybersécurité.

Et vous, êtes-vous prêts à laisser l’IA collaborer avec vos pentesters pour un futur numérique plus sûr ? Après tout, dans un monde où même les algorithmes aiment plaisanter, pourquoi ne pas mêler efficacité et bonne humeur pour protéger nos frontières digitales ?

Bonne lecture et restez à l’affût des dernières innovations dans le domaine de la cybersécurité – parce que dans la course au hack, il vaut mieux avoir un robot humoristique et un humaniste averti de votre côté !